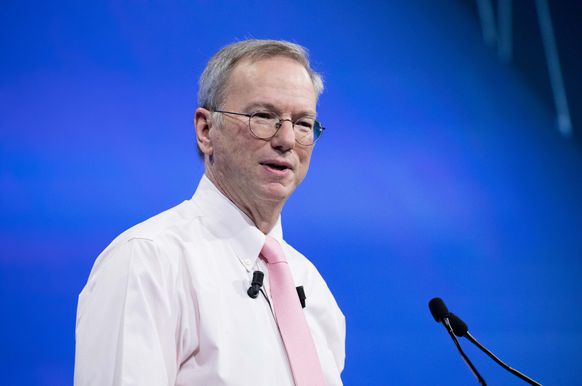

"Yapay zekâ öldürmeyi öğrenebilir"

Google'ın eski CEO'su Eric Schmidt, yapay zekâ modellerinin güvenlik önlemlerinin aşılabildiğini ve kötü aktörlerin eline geçtiğinde kötü sonuçlar doğurabileceğini belirterek "Kötü bir örnek, birini nasıl öldüreceklerini öğrenmeleri olurdu" dedi

Google’ın 2001-2011 yılları arasında CEO’luğunu üstlenen Eric Schmidt, katıldığı bir zirvede yapay zekânın kötüye kullanım risklerine dikkat çekti. “Yapay zekâda bir 'aşırı yayılma' sorunu olma ihtimali var mı? Kesinlikle” diyen Schmidt, teknolojinin kötü aktörlerin eline geçerek yeniden amaçlandırılabileceğini ve suistimal edilebileceğini belirtti.

Schmidt, “Kapalı ya da açık modelleri alıp koruma kalkanlarını kaldıracak şekilde hacklemenin mümkün olduğuna dair kanıtlar var. Eğitim sırasında pek çok şey öğreniyorlar; kötü bir örnek, birini nasıl öldüreceklerini öğrenmeleri olurdu” ifadesini kullandı.

Schmidt, yapay zekâ risklerini sınırlayacak etkili bir “yayılmayı önleme rejimi”nin (non-proliferation) henüz bulunmadığını vurguladı.

Schmidt, bu uyarılarına rağmen yapay zekânın genel gidişatına dair olumlu açıklamalarda da bulundu. “Bu teknoloji abartılmıyor, hatta yeterince abartılmıyor” diyen Schmidt, “Bize tam olarak benzemeyen ve büyük ölçüde kontrolümüz altında olan ‘yabancı bir zekânın’ gelişi insanlık için çok büyük bir gelişme” yorumunu yaptı.

"MUAZZAM GETİRİ" BEKLENTİSİ

Yapay zekâda yatırımların hızlandığı, değerlemelerin dot-com balonuyla kıyaslandığının belirtilmesi üzerine ise Schmidt, tarihin tekerrür etmeyeceğini düşündüğüne belirterek şunları söyledi:

“Bence burada öyle olmayacak ama profesyonel bir yatırımcı değilim. Bildiğim şu ki, buraya parasını koyanlar uzun vadede getirinin muazzam olacağına inanıyor; başka neden bu riski alsınlar?”